Địa chỉ:

Lầu 7 Tòa nhà STA, 618 đường 3/2, Phường Diên Hồng (Phường 14, Quận 10), TP HCM

Giờ làm việc

Thứ 2 tới thứ 6: 8:00 - 17:00

Địa chỉ:

Lầu 7 Tòa nhà STA, 618 đường 3/2, Phường Diên Hồng (Phường 14, Quận 10), TP HCM

Giờ làm việc

Thứ 2 tới thứ 6: 8:00 - 17:00

Trong kỷ nguyên Big Data, dữ liệu đã trở thành tài sản chiến lược quý giá nhất của mọi doanh nghiệp. Tuy nhiên, nếu chỉ sở hữu dữ liệu mà không có khả năng khai thác, chúng ta sẽ bỏ lỡ những cơ hội vàng. Để chuyển hóa những luồng thông tin khổng lồ thành giá trị kinh doanh thực thụ, sự kết hợp giữa AI in Data Analytics là lời giải tối ưu nhất, vượt xa các phương pháp thống kê truyền thống.

AI in Data Analytics là việc ứng dụng trí tuệ nhân tạo để nâng cấp toàn diện các giải pháp phân tích hiện nay, từ việc xử lý dữ liệu thô đến việc trích xuất thông tin giá trị cho quá trình ra quyết định. Công nghệ này cho phép tạo ra các insights, tự động hóa quy trình và mở ra những khả năng hoàn toàn mới trong việc thiết lập hệ thống phân tích.

Điểm khác biệt cốt lõi nằm ở khả năng điều tra chuyên sâu. AI trong phân tích dữ liệu không chỉ tìm câu trả lời cho câu hỏi “Chuyện gì đã xảy ra?” mà còn tiến xa hơn để hiểu rõ “Tại sao nó lại xảy ra”. Với các thuật toán tinh vi, AI có khả năng dự đoán chính xác “Chuyện gì sẽ xảy ra tiếp theo” trong tương lai, thay vì chỉ phụ thuộc vào kiến thức hạn hẹp của con người để giải thích các thông tin thu được.

Sức mạnh của AI trong phân tích dữ liệu không đến từ một thuật toán đơn lẻ, mà là sự hội tụ của nhiều công nghệ tiên tiến, mỗi công nghệ đóng một vai trò chuyên biệt trong việc xử lý và giải mã thông tin:

Machine Learning là nền tảng quan trọng nhất trong hệ sinh thái AI. Khác với lập trình truyền thống dựa trên các quy tắc cứng nhắc, Machine Learning cho phép hệ thống tự học hỏi từ các tập dữ liệu lịch sử để nhận diện các quy luật phức tạp.

Trong phân tích dữ liệu, các thuật toán như hồi quy, phân cụm và phân loại giúp doanh nghiệp tự động hóa việc tìm kiếm các xu hướng tiềm ẩn. Khả năng tự cải thiện độ chính xác theo thời gian giúp các mô hình ML trở nên nhạy bén hơn khi tiếp nhận thêm dữ liệu mới, từ đó đưa ra các dự báo sát với thực tế nhất.

NLP cho phép máy tính hiểu, diễn giải và phản hồi lại ngôn ngữ tự nhiên của con người. Trong lĩnh vực phân tích, NLP đóng vai trò then chốt trong việc xử lý dữ liệu phi cấu trúc – loại dữ liệu chiếm tới 80% lượng thông tin của doanh nghiệp hiện nay (như email, bài đăng mạng xã hội, đánh giá khách hàng).

Nhờ có NLP, hệ thống có thể thực hiện phân tích cảm xúc (Sentiment Analysis) để biết khách hàng đang hài lòng hay giận dữ, hoặc cho phép người dùng đặt câu hỏi trực tiếp cho dữ liệu bằng ngôn ngữ nói hằng ngày thay vì phải viết các câu lệnh truy vấn SQL phức tạp.

Mạng thần kinh nhân tạo (Neural Networks) và Học sâu (Deep Learning) là các kỹ thuật nâng cao mô phỏng cấu trúc nơron của não bộ con người. Chúng đặc biệt hiệu quả khi xử lý các tập dữ liệu cực lớn và phức tạp mà các thuật toán thông thường không thể đảm đương.

Deep Learning có thể tự động trích xuất các đặc trưng từ dữ liệu thô như hình ảnh y tế, âm thanh hoặc video để phục vụ phân tích. Đây là công nghệ đứng sau các hệ thống nhận diện khuôn mặt, phân tích hành vi qua camera an ninh hoặc nhận diện giọng nói, mang lại những chiều không gian phân tích mới mẻ cho doanh nghiệp.

AutoML là một bước tiến đột phá giúp đơn giản hóa quy trình xây dựng các mô hình phân tích. Thông thường, việc chọn lọc dữ liệu, tinh chỉnh tham số và kiểm thử mô hình đòi hỏi các chuyên gia khoa học dữ liệu (Data Scientist) trình độ cao. AutoML tự động hóa các bước này, cho phép ngay cả những người dùng không chuyên cũng có thể tạo ra các mô hình dự báo chất lượng cao. Điều này không chỉ giúp tiết kiệm thời gian, giảm thiểu sai sót do con người mà còn giúp các doanh nghiệp nhanh chóng triển khai các ứng dụng AI vào thực tế sản xuất kinh doanh.

Cách tiếp cận “Analytics as Code” là phương thức hiệu quả và thân thiện với lập trình viên nhất hiện nay. Thay vì phụ thuộc vào giao diện kéo thả (UI) truyền thống, phương thức này sử dụng API mở, Python SDK và các ngôn ngữ định dạng như YAML hoặc JSON để xây dựng và quản lý các đối tượng phân tích. Mô hình này (còn được gọi là Headless BI) giúp các đội ngũ dễ dàng cộng tác qua GitHub/GitLab, quản lý phiên bản và theo dõi sự thay đổi của dự án theo thời gian. Đây cũng là điều kiện tiên quyết để tích hợp LLM vào nền tảng phân tích.

Mặc dù AI có thể hiểu các cấu trúc mã phức tạp nhưng người dùng kinh doanh thì không. “Semantic Layer” đóng vai trò chuyển đổi các biểu thức kỹ thuật và siêu dữ liệu trong mô hình dữ liệu thành các thuật ngữ kinh doanh thân thiện. Khi kết hợp với LLM, lớp ngữ nghĩa này cho phép AI hiểu các câu hỏi bằng ngôn ngữ tự nhiên và chuyển đổi chúng thành các lệnh truy vấn có cấu trúc mà hệ thống phân tích có thể thực thi, giúp “dân chủ hóa” dữ liệu cho mọi tầng lớp nhân sự.

Việc triển khai AI trong phân tích dữ liệu thường xoay quanh ba thành phần chính của xử lý ngôn ngữ tự nhiên:

AI không chỉ hỗ trợ người dùng cuối mà còn hỗ trợ trực tiếp các nhà phát triển. Với khả năng tự động tạo các đoạn mã (code snippets) từ yêu cầu bằng ngôn ngữ tự nhiên, AI giúp đơn giản hóa việc kết nối nguồn dữ liệu, sửa đổi mô hình dữ liệu logic và quản lý người dùng. Điều này giúp rút ngắn đáng kể thời gian thiết lập hệ thống ban đầu và mang lại trải nghiệm tùy chỉnh cá nhân hóa hơn.

Hiện nay, cuộc đua tích hợp AI trong phân tích dữ liệu đang diễn ra cực kỳ sôi động với sự góp mặt của các ông lớn công nghệ. Dưới đây là những công cụ hàng đầu giúp tối ưu hóa quy trình phân tích:

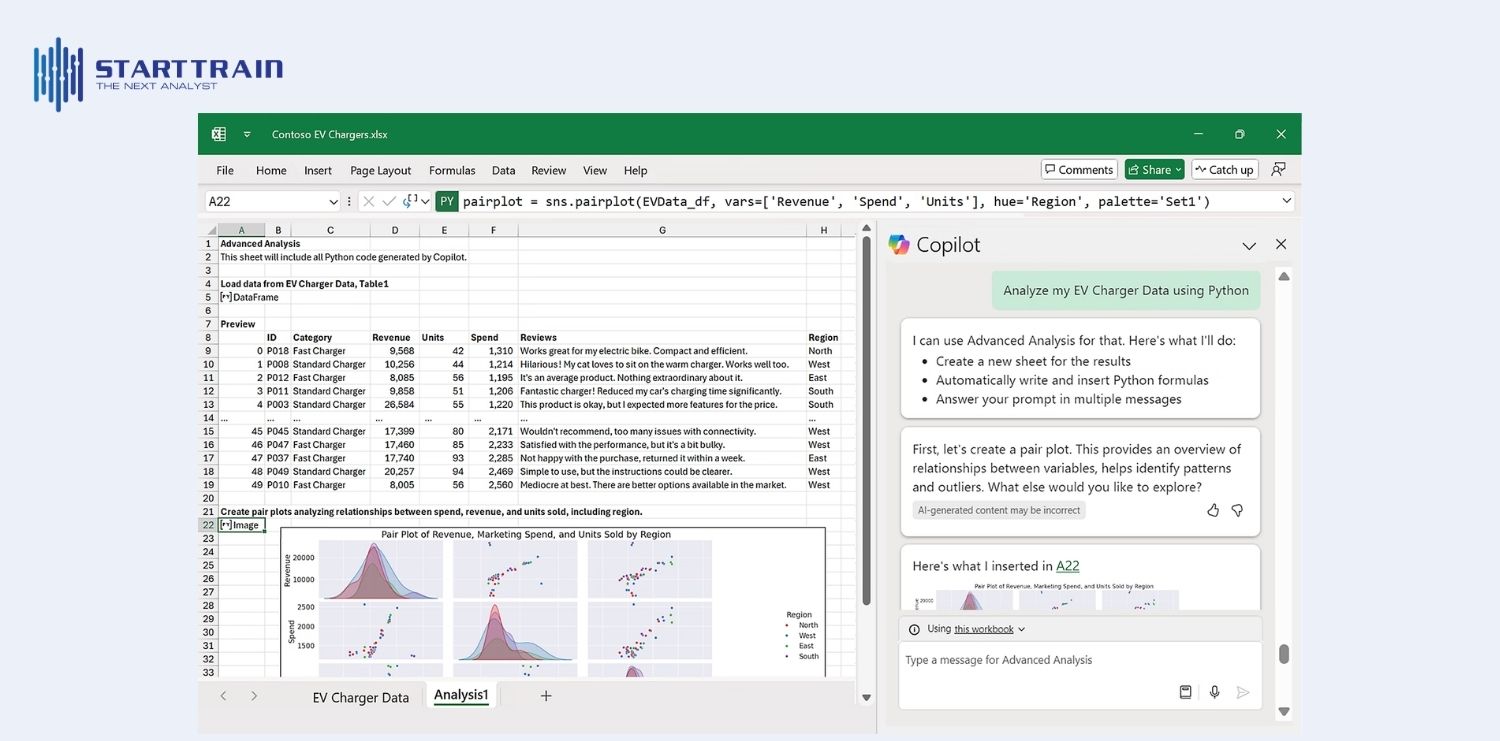

Được tích hợp trực tiếp vào hệ sinh thái Microsoft 365, Copilot là trợ thủ đắc lực cho người dùng Excel và Power BI. Trong Excel, Copilot có thể tự động tạo công thức phức tạp, phân tích xu hướng và tạo biểu đồ chỉ từ một yêu cầu ngắn. Với Power BI, công cụ này hỗ trợ tạo báo cáo nhanh chóng, viết mã DAX và đưa ra các tóm tắt thông minh về dữ liệu, giúp rút ngắn thời gian từ dữ liệu thô đến dashboard hoàn chỉnh.

Claude nổi bật với khả năng tư duy logic và xử lý ngữ cảnh cực kỳ tốt. Đối với các nhà phân tích dữ liệu, Claude thường được sử dụng như một chuyên gia tư vấn để can thiệp viết và tối ưu hóa các công thức Excel cũng như giải quyết các bài toán logic DAX trong Power BI. Khả năng đọc hiểu các tệp dữ liệu lớn và giải thích các mối quan hệ phức tạp giúp Claude trở thành công cụ hỗ trợ phân tích định tính và xử lý mã nguồn hiệu quả.

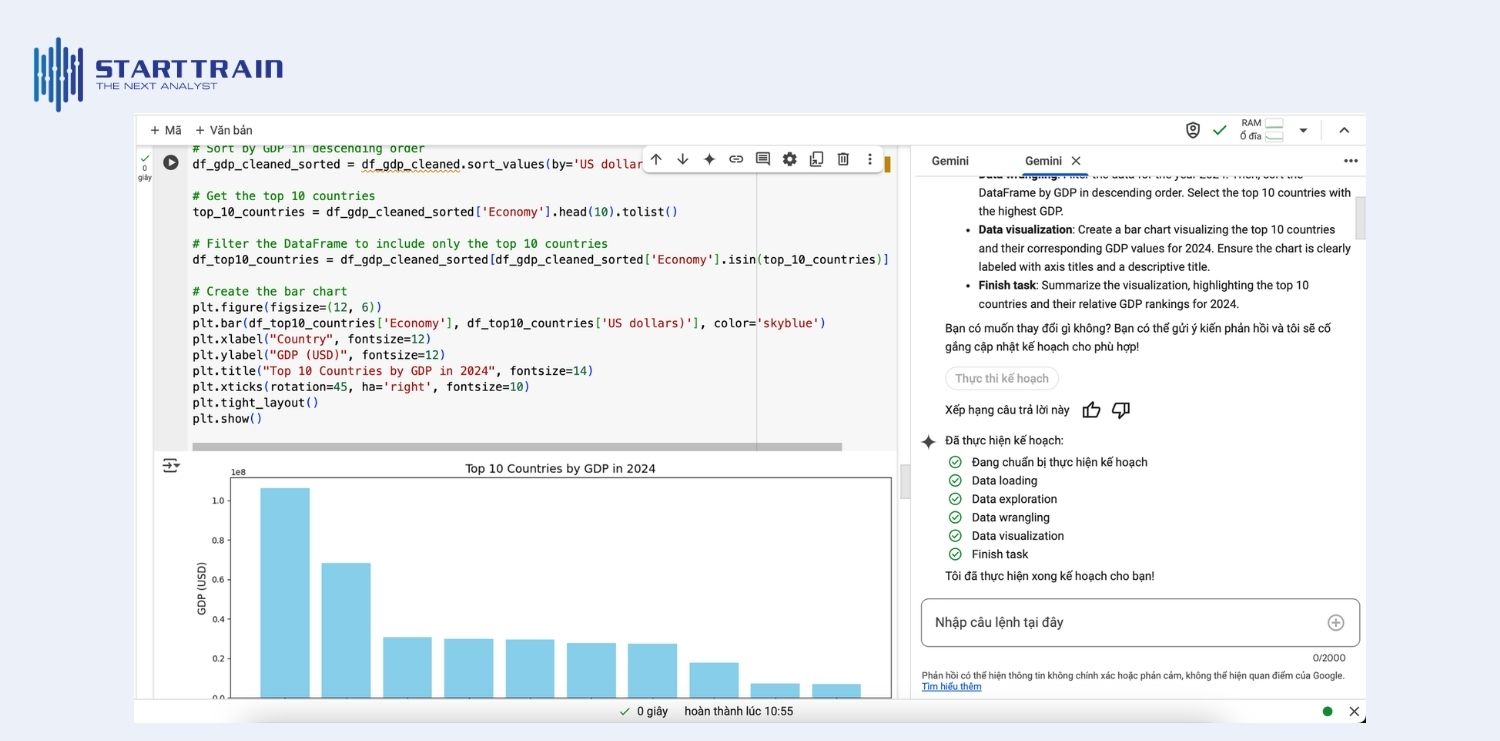

Trong môi trường phân tích dữ liệu lập trình, Gemini được tích hợp sâu vào Google Colab. Nó hỗ trợ các nhà khoa học dữ liệu viết code Python, debug lỗi và giải thích các thư viện phân tích dữ liệu như Pandas, Numpy hay Matplotlib. Nhờ khả năng kết nối tốt với hệ sinh thái Google Cloud, Gemini giúp tự động hóa các quy trình từ thu thập dữ liệu đến huấn luyện mô hình Machine Learning ngay trên trình duyệt.

Mặc dù mang lại lợi ích khổng lồ, việc triển khai AI trong phân tích dữ liệu là một hành trình đầy thách thức, đòi hỏi sự cẩn trọng từ phía doanh nghiệp:

AI in Data Analytics không còn là một khái niệm xa xỉ mà đã trở thành yếu tố sống còn đối với mọi doanh nghiệp trong kỷ nguyên số. Việc kết hợp sức mạnh trí tuệ nhân tạo vào phân tích dữ liệu không chỉ giúp tối ưu hóa quy trình vận hành mà còn mở ra những cơ hội đột phá để thấu hiểu khách hàng và dự báo tương lai.

Mặc dù vẫn còn tồn tại những thách thức về đạo đức và kỹ thuật, nhưng với lộ trình triển khai đúng đắn, AI trong phân tích dữ liệu sẽ là trợ lý đắc lực đưa doanh nghiệp vươn tới những tầm cao mới dựa trên những quyết định sáng suốt từ dữ liệu.