Địa chỉ:

Lầu 7 Tòa nhà STA, 618 đường 3/2, Phường Diên Hồng (Phường 14, Quận 10), TP HCM

Giờ làm việc

Thứ 2 tới thứ 6: 8:00 - 17:00

Địa chỉ:

Lầu 7 Tòa nhà STA, 618 đường 3/2, Phường Diên Hồng (Phường 14, Quận 10), TP HCM

Giờ làm việc

Thứ 2 tới thứ 6: 8:00 - 17:00

Trong thời đại chuyển đổi số, dữ liệu chính là nền tảng cốt lõi cho mọi chiến lược kinh doanh và sự phát triển của trí tuệ nhân tạo. Tuy nhiên, một khối lượng dữ liệu khổng lồ nhưng lại chứa đầy sai sót, trùng lặp hay thiếu hụt sẽ trở thành một gánh nặng hơn là một tài sản. Để dữ liệu thực sự trở thành công cụ đắc lực, nó cần trải qua quá trình tinh lọc khắt khe được gọi là Data Cleaning. Vậy Data Cleaning là làm gì và tại sao nó lại đóng vai trò sống còn trong phân tích dữ liệu? Hãy cùng Starttrain tìm hiểu chi tiết qua bài viết dưới đây.

Data Cleaning (Làm sạch dữ liệu) là quá trình xác định và chỉnh sửa hoặc loại bỏ các dữ liệu không chính xác, bị hỏng, định dạng sai, trùng lặp hoặc không đầy đủ trong một tập dữ liệu. Khi doanh nghiệp kết hợp nhiều nguồn dữ liệu khác nhau để phân tích, cơ hội để dữ liệu bị trùng lặp hoặc dán nhãn sai là rất lớn. Quá trình làm sạch sẽ giúp lọc bỏ những điểm nhiễu này để giữ lại những thông tin giá trị nhất.

Bản chất của làm sạch dữ liệu không chỉ là xóa bỏ thông tin cũ. Nó đòi hỏi việc chuẩn hóa các định dạng, xử lý các giá trị trống (missing values) và đảm bảo mọi bản ghi đều tuân thủ một quy tắc logic nhất định. Nếu dữ liệu không chính xác, các kết quả đầu ra và thuật toán sẽ trở nên thiếu tin cậy, ngay cả khi các biểu đồ trông có vẻ chuyên nghiệp và hợp lý.

Trên thực tế, không có một phương pháp cố định nào có thể áp dụng cho mọi loại dữ liệu vì tính chất của mỗi tập dataset là khác nhau. Tuy nhiên, việc thiết lập một khung quy trình (template) chuẩn cho công tác làm sạch dữ liệu là vô cùng quan trọng. Điều này giúp đội ngũ chuyên gia đảm bảo tính nhất quán, thực hiện đúng các bước cần thiết trong mọi dự án và hạn chế tối đa sai sót từ yếu tố con người.

Làm sạch dữ liệu hiện nay được coi là một bước tối quan trọng trong quy trình Data Preparation (Chuẩn bị dữ liệu), thường chiếm tới 60-80% thời gian của một dự án khoa học dữ liệu.

Trong kỷ nguyên quản trị bằng dữ liệu, việc sở hữu một nguồn dữ liệu sạch và được quản lý tốt giúp các tổ chức trang bị khả năng ra quyết định chính xác, phản ứng nhanh nhạy trước các biến động thị trường và tối ưu hóa quy trình vận hành. Khi dữ liệu được tinh lọc, rủi ro từ những quyết định sai lầm dựa trên thông tin nhiễu sẽ được giảm thiểu tối đa.

Làm sạch dữ liệu là một thành phần không thể tách rời của khoa học dữ liệu, đóng vai trò là bước đệm thiết yếu cho quá trình chuyển đổi dữ liệu (data transformation). Trong khi làm sạch dữ liệu giúp cải thiện chất lượng nguồn tin, thì chuyển đổi dữ liệu sẽ biến những dữ liệu thô chất lượng đó thành định dạng có thể sử dụng để phân tích sâu.

Sự kết hợp này cho phép doanh nghiệp khai phá toàn bộ tiềm năng từ các công cụ trí tuệ doanh nghiệp (BI), kho dữ liệu (data warehouses) và phân tích dữ liệu lớn (big data analytics). Nếu nguồn dữ liệu đầu vào không sạch, kết quả từ những công nghệ này sẽ trở nên thiếu tin cậy, dẫn đến sự lãng phí tài nguyên và kém hiệu quả trong vận hành.

Tương tự, dữ liệu sạch là yếu tố then chốt quyết định sự thành công của AI và Machine Learning (ML) trong tổ chức. Làm sạch dữ liệu đảm bảo rằng các thuật toán học máy được huấn luyện trên những tập dữ liệu chính xác, nhất quán và không thiên kiến (unbiased). Thiếu đi nền tảng dữ liệu sạch, các thuật toán có thể đưa ra những dự báo sai lệch, không ổn định, từ đó làm giảm hiệu quả và độ tin cậy của các hệ thống hỗ trợ ra quyết định tự động.

Thông thường, không có quy trình cố định nào cho các bước Data Cleaning. Người làm dữ liệu cần quan sát, dựa vào mục tiêu phân tích và hiểu biết về bộ dữ liệu để linh hoạt áp dụng các kỹ thuật khác nhau sao cho phù hợp nhất. Tuy nhiên, nhìn chung, các bước Data Cleaning thường bao gồm:

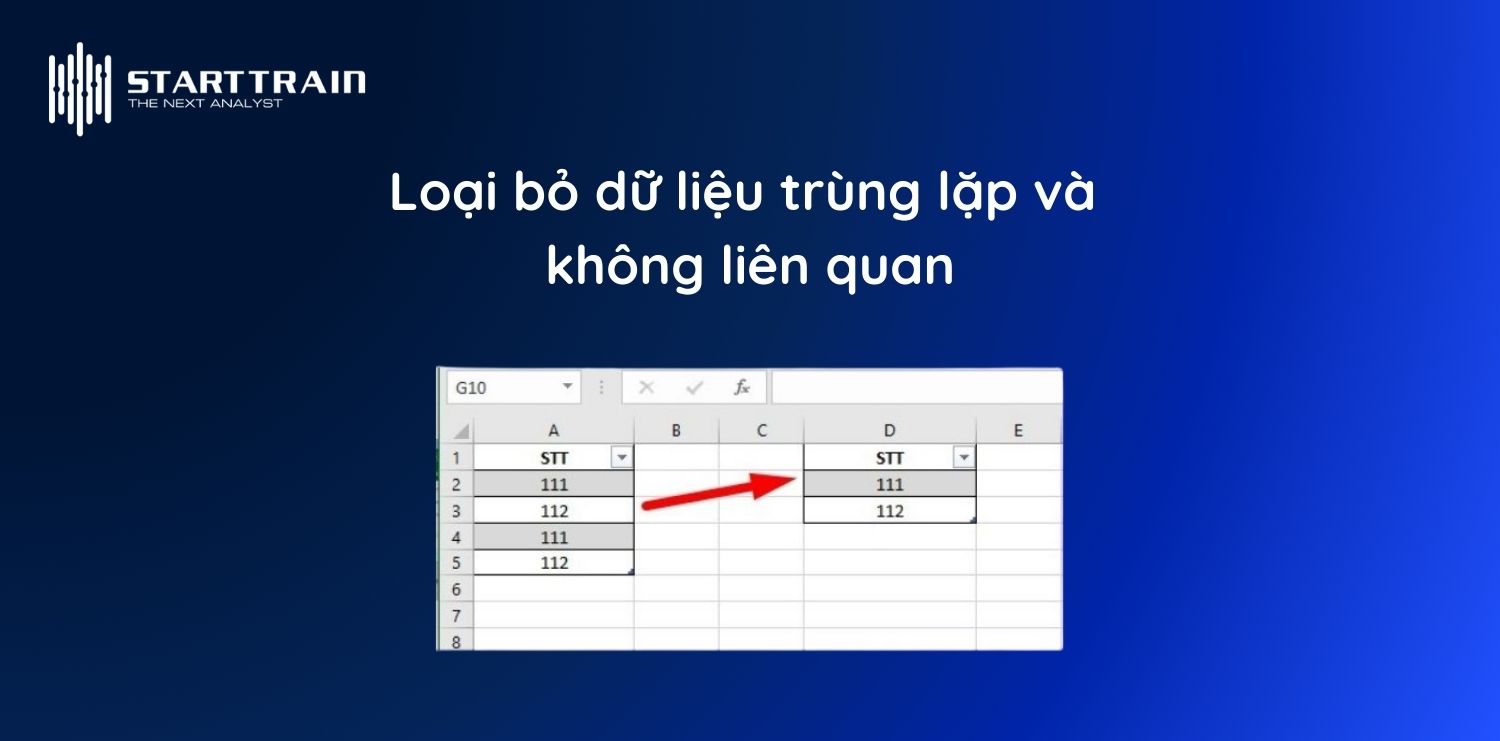

Dữ liệu trùng lặp thường xuất hiện khi bạn kết hợp dữ liệu từ nhiều nguồn hoặc khi khách hàng gửi thông tin nhiều lần. Việc loại bỏ các quan sát trùng lặp (duplicates) giúp tập dữ liệu gọn nhẹ và chính xác hơn. Đồng thời, hãy lọc bỏ các thông tin không liên quan, những dữ liệu không phục vụ cho bài toán phân tích hiện tại, để tránh gây nhiễu và lãng phí tài nguyên tính toán.

Lỗi cấu trúc bao gồm các sai sót về cú pháp, lỗi chính tả hoặc cách đặt tên biến không thống nhất. Ví dụ, trong một cột địa chỉ, “Hồ Chí Minh”, “TP. HCM” và “saigon” cần được quy về một định dạng chuẩn duy nhất. Bước này cũng bao gồm việc xử lý các vấn đề về viết hoa/viết thường không đồng đều và đảm bảo kiểu dữ liệu (Data Type) của mỗi cột là chính xác.

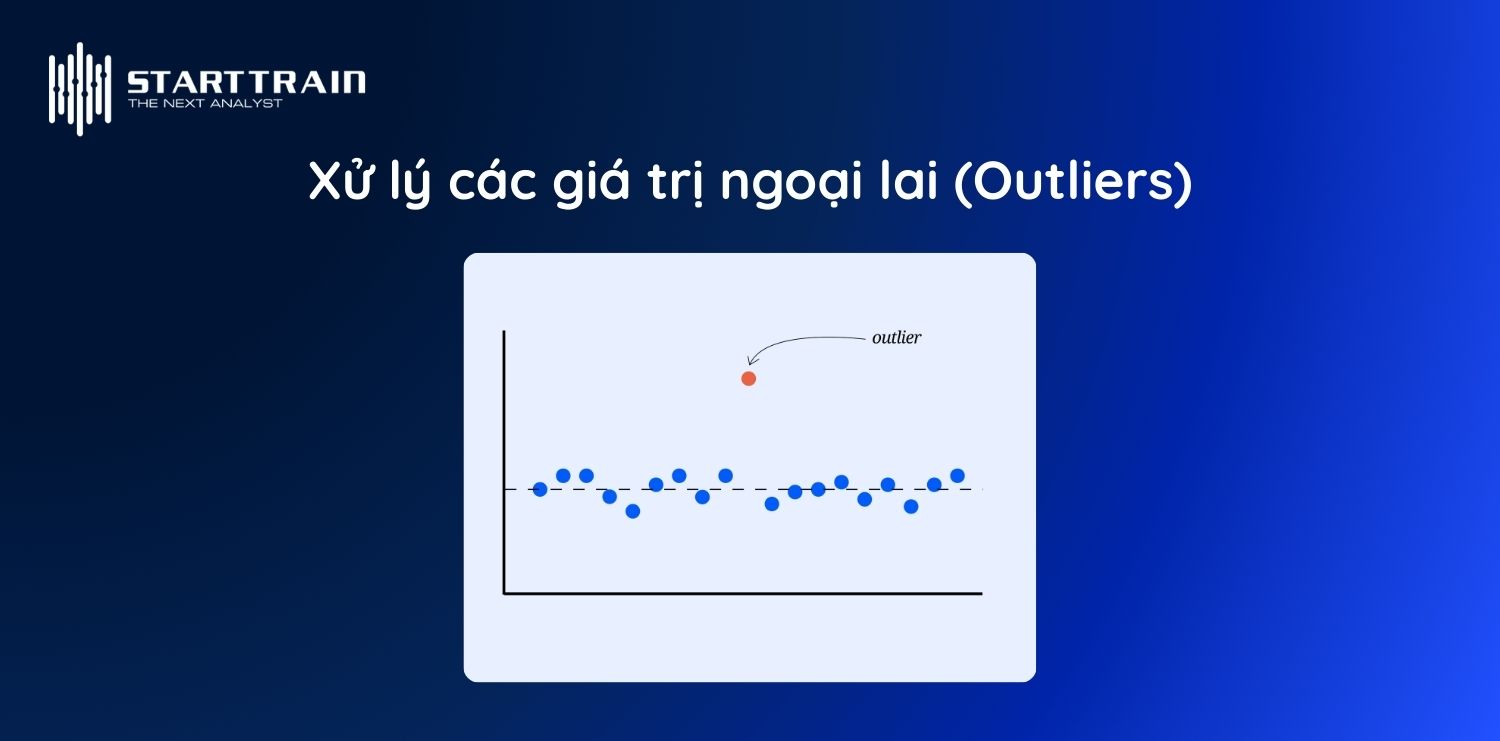

Các giá trị ngoại lai là những điểm dữ liệu khác biệt quá lớn so với phần còn lại của tập hợp. Bạn cần phân tích kỹ xem đó là lỗi nhập liệu hay là một biến động thực tế của thị trường. Nếu là lỗi, hãy điều chỉnh hoặc loại bỏ. Nếu là giá trị thực, hãy cân nhắc giữ lại vì chúng có thể chứa đựng những thông tin quan trọng cho các phân tích đặc biệt.

Dữ liệu trống (null) là vấn đề cực kỳ phổ biến. Bạn có thể chọn cách loại bỏ hoàn toàn các bản ghi bị thiếu thông tin nếu số lượng không đáng kể. Tuy nhiên, một cách tiếp cận phổ biến hơn là thay thế (Imputation) bằng các giá trị như số trung bình, trung vị hoặc sử dụng các thuật toán dự đoán để điền vào ô trống. Việc lựa chọn phương pháp nào phụ thuộc hoàn toàn vào tác động của dữ liệu đó đối với mô hình phân tích cuối cùng.

Sau khi thực hiện các bước trên, bước cuối cùng là xác thực lại toàn bộ tập dữ liệu. Bạn cần trả lời các câu hỏi như: Dữ liệu đã tuân thủ đúng các quy tắc logic chưa? Các con số có nằm trong khoảng hợp lý không? Có còn các lỗi định dạng nào sót lại không? Việc kiểm tra kỹ lưỡng này đảm bảo rằng dữ liệu đã sẵn sàng để đưa vào các công cụ BI hoặc mô hình Machine Learning mà không gây ra sai sót.

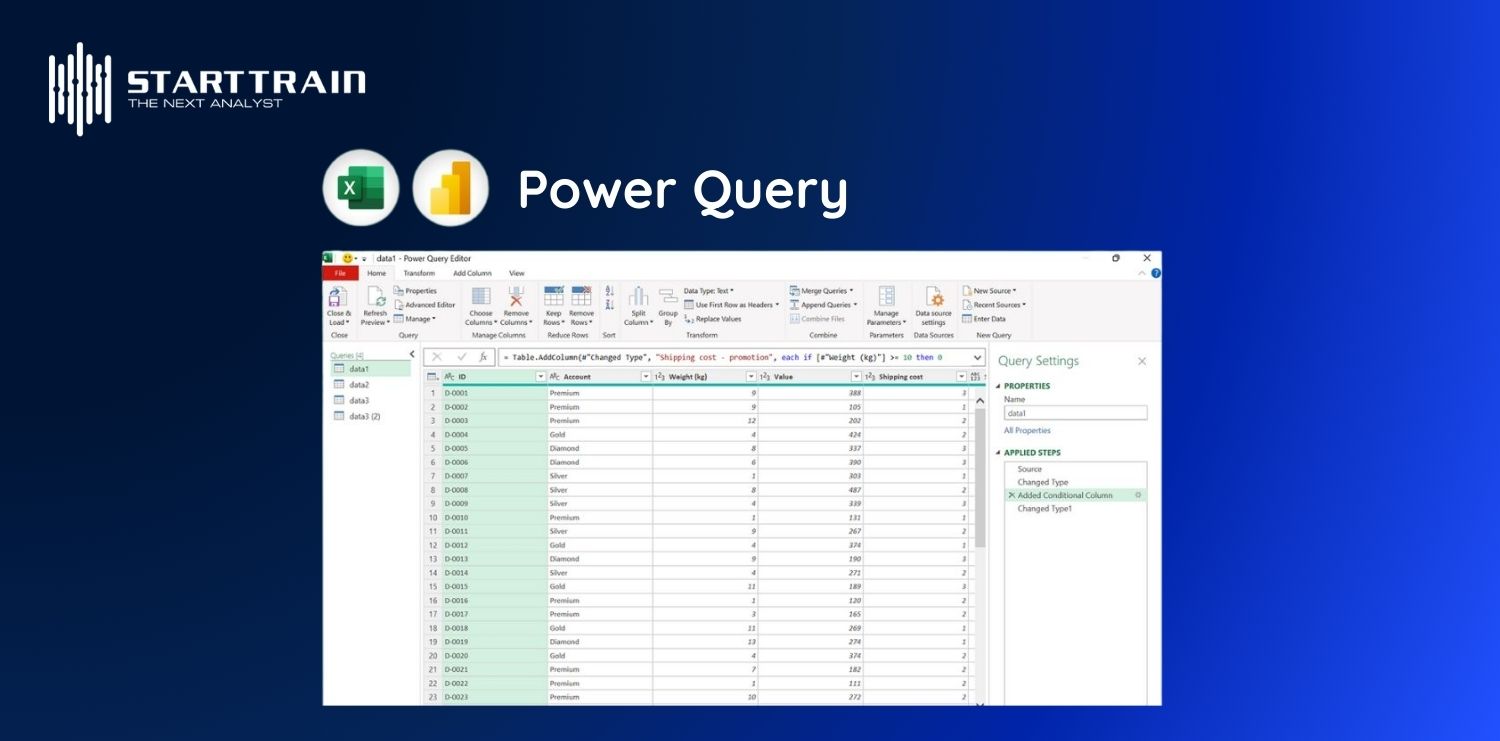

Đối với các nhà phân tích dữ liệu sử dụng Excel hoặc Power BI, Power Query là một công cụ ETL (Extract, Transform, Load) cực kỳ mạnh mẽ giúp đơn giản hóa quy trình làm sạch dữ liệu mà không cần kỹ năng lập trình phức tạp.

Các tính năng làm sạch phổ biến trong Power Query:

Các quyết định dựa trên dữ liệu sạch và chất lượng cao có khả năng mang lại hiệu quả vượt trội, đảm bảo sự nhất quán với các mục tiêu kinh doanh dài hạn. Ngược lại, những quyết định dựa trên dữ liệu “bẩn” (chứa lỗi chính tả, dữ liệu trùng lặp hoặc mâu thuẫn) thường dẫn đến sự lãng phí tài nguyên, làm lu mờ các cơ hội tiềm năng và gây ra những bước đi chiến lược sai lầm. Khi dữ liệu chính xác, ban lãnh đạo có thể tự tin hơn trong việc định hướng công ty.

Làm sạch dữ liệu giúp loại bỏ các rào cản thông tin, cho phép nhân sự tập trung vào các nhiệm vụ chuyên môn thay vì tốn hàng giờ đồng hồ để sửa lỗi thủ công. Khi dữ liệu đã được chuẩn hóa, quá trình xử lý và truy xuất thông tin diễn ra nhanh chóng hơn, giúp đội ngũ phân tích có thêm thời gian để khai thác các giá trị tiềm ẩn (insights) thay vì chỉ dừng lại ở việc xử lý sự cố.

Dữ liệu kém chất lượng là nguyên nhân gốc rễ của nhiều sai sót tốn kém, ví dụ như nhập quá nhiều hàng tồn kho do số liệu trùng lặp hoặc triển khai các chiến dịch marketing sai đối tượng do thông tin khách hàng không đầy đủ. Data Cleaning giúp doanh nghiệp ngăn chặn những rủi ro vận hành này, từ đó tiết kiệm ngân sách đáng kể và tối ưu hóa việc sử dụng nguồn vốn.

Trong bối cảnh các quy định bảo mật ngày càng khắt khe, dữ liệu sạch đóng vai trò bảo chứng cho sự tuân thủ pháp lý của tổ chức. Bằng cách giữ cho thông tin chính xác và luôn được cập nhật, doanh nghiệp tránh được việc vô tình lưu giữ các dữ liệu nhạy cảm dư thừa hoặc lỗi thời, từ đó giảm thiểu đáng kể nguy cơ rò rỉ thông tin và các rủi ro về an ninh mạng.

Làm sạch dữ liệu là điều kiện tiên quyết để xây dựng và huấn luyện các mô hình học máy thành công. Một tập dữ liệu sạch giúp cải thiện độ chính xác của kết quả đầu ra, đảm bảo mô hình có khả năng khái quát hóa tốt khi áp dụng vào các tình huống thực tế mới. Điều này giúp doanh nghiệp sở hữu những hệ thống dự báo mạnh mẽ, ổn định và đáng tin cậy hơn.

Quá trình làm sạch dữ liệu đảm bảo rằng các tập dữ liệu từ nhiều nguồn khác nhau có thể “giao tiếp” hiệu quả khi được kết hợp lại. Việc chuẩn hóa định dạng và tiêu chuẩn dữ liệu giúp loại bỏ các xung đột hệ thống, đảm bảo tính nhất quán trên toàn bộ hạ tầng công nghệ thông tin của tổ chức, từ đó hỗ trợ việc chia sẻ và khai thác thông tin giữa các phòng ban diễn ra trơn tru.

Làm sạch dữ liệu không phải là một công việc đơn giản; thực tế, đây thường là giai đoạn chiếm tới một nửa hoặc thậm chí là phần lớn thời gian làm việc của một Data Analyst. Dưới đây là những thách thức phổ biến mà các tổ chức thường gặp phải:

Làm sạch dữ liệu là một tác vụ cực kỳ tốn thời gian, đặc biệt là với các tập dữ liệu lớn và phức tạp. Quy trình này đòi hỏi sự đầu tư đáng kể về nỗ lực và chuyên môn của nhân sự. Ngoài ra, doanh nghiệp thường phải chi trả cho các phần mềm chuyên dụng và hạ tầng tính toán để xử lý khối lượng bản ghi khổng lồ một cách tự động.

Đây là một quy trình dễ xảy ra sai sót nếu không được kiểm soát chặt chẽ. Việc loại bỏ hoặc chỉnh sửa dữ liệu không cẩn thận có thể kéo theo hệ quả là đánh mất các thông tin quan trọng, khiến tập dữ liệu trở nên không đầy đủ và làm sai lệch kết quả phân tích cuối cùng. Điều này tạo ra một sự đánh đổi khó khăn trong lựa chọn giữa việc loại bỏ nhiễu và việc giữ lại thông tin.

Một thách thức lớn đối với người xử lý dữ liệu là kiến thức hạn chế về nguyên nhân gây ra các sự bất thường trong dữ liệu (anomalies). Nếu không hiểu rõ bản chất của lĩnh vực (domain knowledge), nhà phân tích sẽ rất khó khăn trong việc đưa ra các phương án xử lý phù hợp cho từng loại lỗi cụ thể, dẫn đến việc làm sạch không triệt để hoặc sai cách.

Rất khó để xây dựng một kế hoạch chi tiết hoặc biểu đồ quy trình làm sạch dữ liệu hoàn hảo trước khi các vấn đề thực sự xảy ra. Hơn nữa, dữ liệu luôn biến động, đòi hỏi quá trình bảo trì và làm sạch liên tục để đảm bảo chất lượng theo thời gian. Việc bảo trì không ngừng nghỉ này có thể gây tốn kém và làm chậm tốc độ vận hành của dự án.

Trong lĩnh vực Machine Learning, việc làm sạch dữ liệu quá mức (ví dụ như loại bỏ quá nhiều dữ liệu ngoại lai hoặc các trường hợp đặc biệt) có thể góp phần gây ra hiện tượng overfitting. Khi đó, mô hình sẽ quá khớp với tập dữ liệu, dẫn đến việc mất đi khả năng dự báo chính xác khi gặp các dữ liệu thực tế mới trong tương lai.

Tóm lại, Data Cleaning không chỉ là một công việc kỹ thuật đơn thuần mà là một tư duy quản trị tài sản số hiện đại. Việc đầu tư thời gian và nguồn lực vào làm sạch dữ liệu ngay từ đầu sẽ là nền tảng vững chắc để doanh nghiệp tránh được bẫy “Garbage In, Garbage Out”, từ đó tạo ra những giá trị thực thực từ phân tích kinh doanh và trí tuệ nhân tạo. Hãy coi làm sạch dữ liệu là một khoản đầu tư xứng đáng cho tương lai số của doanh nghiệp bạn.

Để nâng tầm kỹ năng xử lý dữ liệu từ bảng tính thô thành các báo cáo chuyên nghiệp, hãy tham khảo ngay khóa học Business Intelligence Essentials tại Starttrain. Khóa học sẽ giúp bạn làm chủ các công cụ làm sạch dữ liệu mạnh mẽ như Power Query và xây dựng tư duy phân tích thực chiến.